非同期RLトレーニングでGPU効率化 16ライブラリ分析

アミン・ディルフーシ氏らが2026年3月、16のオープンソース強化学習(RL)ライブラリを分析した。同期RLでは推論がボトルネックとなりGPUが遊休化する問題を解決するため、推論と学習を分離する非同期アーキテクチャの設計指針を提示した。

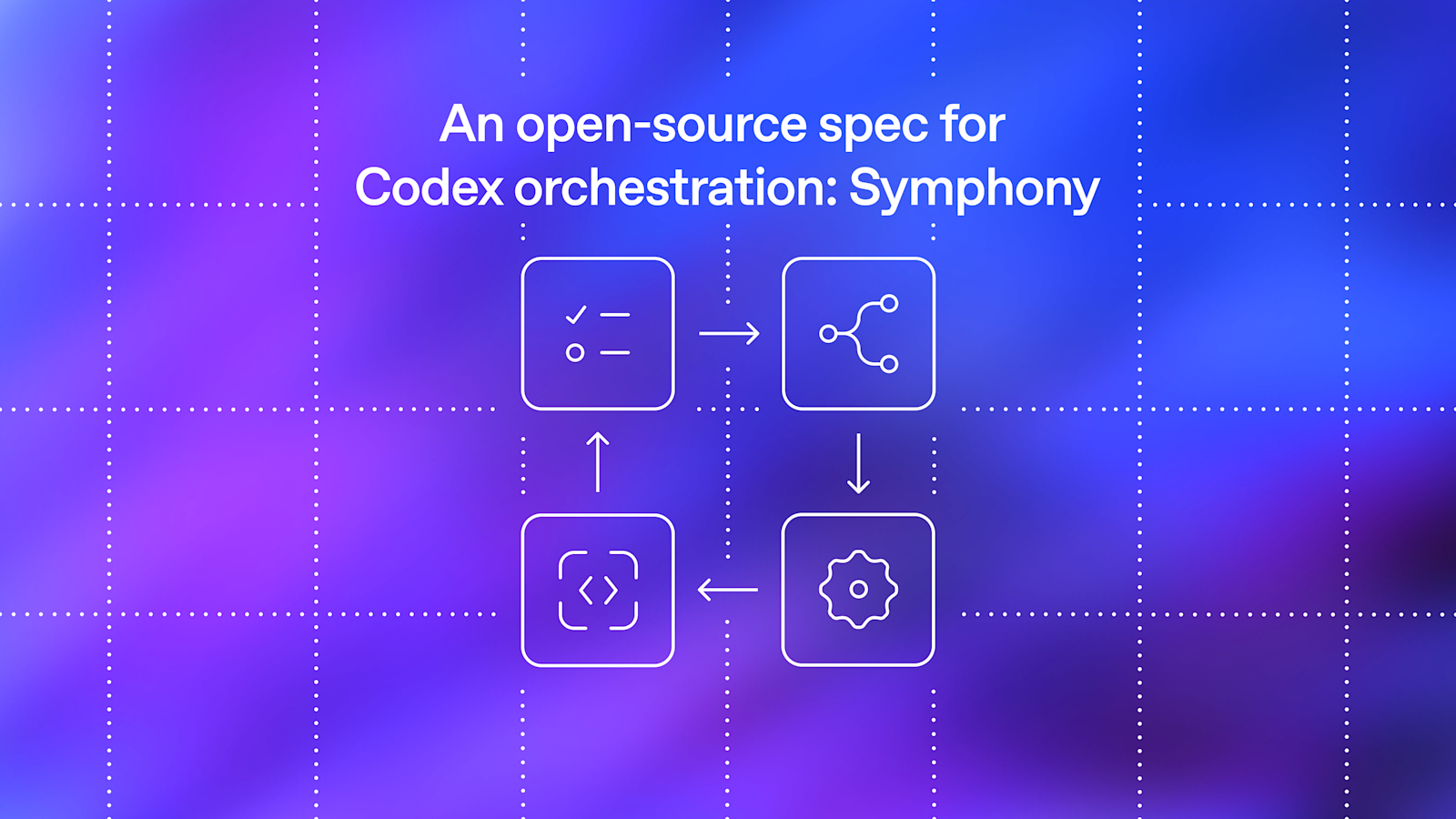

調査ではRayがオーケストレーションを支配し、NCCLが重み転送のデファクトスタンダードとなっていることが判明した。古さ管理やLoRAサポート、分散型MoE対応などの7軸で比較し、非同期処理によるGPUアイドル時間の削減効果を検証した。

従来の同期RLでは320億パラメータモデルの推論中にGPUが待機し、リソース効率が低下していた。推論と学習を別GPUプールで並列実行し、ロールアウトバッファを介して非同期にデータを同期させることで、この課題を解決する。

日本のAI開発企業も大規模言語モデルのポストトレーニングにおいてGPUコスト増に直面している。本知見は、推論と学習の分離によるインフラ最適化に直結し、国内のLLM開発競争力維持に不可欠な技術的指針となる。

今後のトレンドとして、クリティカルフリーアルゴリズムやプロセス報酬、マルチエージェント共進化への対応が重要視される。TRLなどの主要ライブラリも非同期トレーナー設計を進めており、効率的なAI進化の基盤整備が加速する。